Nvidia GTC 2026:traçando o caminho para US$ 1 trilhão em receita de IA

Nvidia GTC (ou GPU Technology Conference) tornou-se uma das principais conferências de IA do mundo, crescendo a cada ano desde o seu lançamento em 2009, juntamente com a influência e as receitas da empresa. Mas este ano marcou uma mudança de ênfase. No passado, a empresa concentrava-se na forma como se expandia para novos mercados; este ano, demonstrou como se expandiria nesses mercados, especialmente como um interveniente-chave em todo o panorama da IA. Num sinal claro das ambições da Nvidia e do seu sucesso atual, ela atualizou a sua projeção de 500 mil milhões de dólares em receitas de IA até 2026 para um espantoso 1 bilião de dólares até 2027.

Em particular, o CEO Jensen Huang abordou as necessidades crescentes de inferência de IA, bem como o rápido crescimento das cargas de trabalho dos agentes e como esse crescimento pode impactar toda a computação de IA.

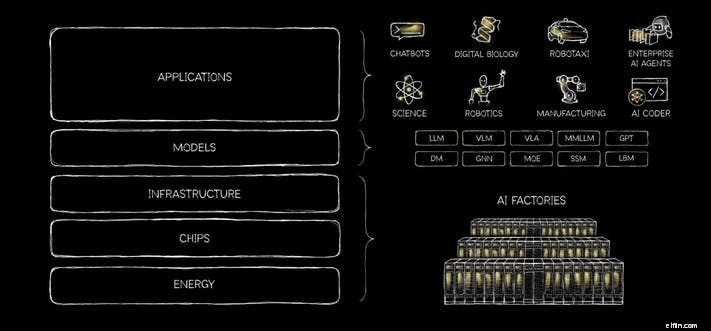

A visão da Nvidia para o Full Stack:o bolo de 5 camadas da AII

Desde dezembro de 2025, Huang promove a ideia de um “bolo de cinco camadas” de IA. Este conceito parece encapsular a estratégia global da empresa para a IA, à medida que tenta comunicar a natureza inerentemente vertical da tecnologia, que é muito mais complexa do que uma simples aplicação ou modelo. A IA é retratada como uma infraestrutura crítica com múltiplas camadas que vão desde requisitos de energia subjacentes até aplicações individuais. Isso também tenta simplificar a complexidade de uma pilha completa de IA para a pessoa média.

Bolo de IA de cinco camadas da Nvidia

Foto cortesia da Nvidia

Na base desta pilha está a energia, que está chamando mais atenção como o fator limitante da quantidade de computação que pode ser construída em qualquer local. Por sua vez, os chips que utilizam essa energia determinam a quantidade de computação disponível para resolver problemas de IA. Em seguida vem a infraestrutura que dá suporte a esses chips com terrenos, edifícios, fornecimento de energia, equipamentos de computação, refrigeração e redes. A infraestrutura permite modelos de IA, que variam dependendo da aplicação e do caso de uso. No nível superior, as próprias aplicações aproveitam os resultados do modelo para fornecer resultados aos consumidores, utilizadores empresariais, entidades governamentais e assim por diante – a base do valor económico da IA.

Huang disse que toda a pilha de computação teve que ser reinventada para suportar “a maior construção de infraestrutura da história da humanidade”. A Nvidia está usando essa mensagem para se posicionar não apenas como fabricante de chips, mas como um facilitador fundamental para toda a computação, porque toda a computação está agora migrando para a IA. O CEO fala sobre a abordagem da Nvidia que combina “integração vertical e abertura horizontal”, o que significa que os seus modelos estão abertos a qualquer pessoa, mas a sua abordagem à computação é integrada verticalmente em todas as camadas.

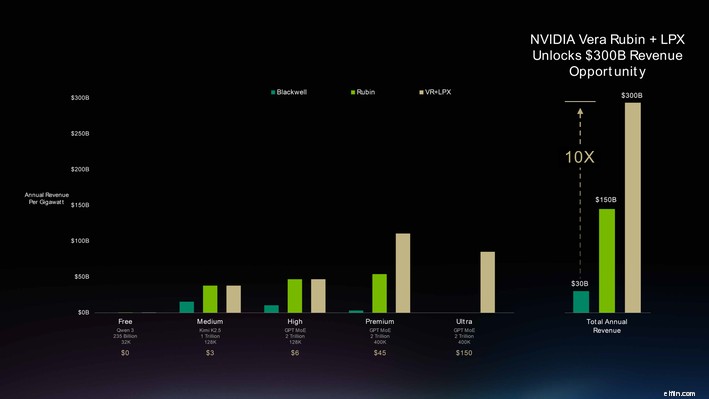

Vera Rubin Pod, LPX e a oportunidade de receita 10x maior

Vera Rubin é a próxima plataforma de computação de ponta da Nvidia que combina suas CPUs Vera e GPUs Rubin; está programado para começar a ser comercializado daqui a alguns meses. O Vera Rubin Pod é a oferta em escala de rack da Nvidia que promete proporcionar mais um aumento significativo na densidade de computação de IA em data centers. Ele incorpora sete tipos de chips da Nvidia em cinco sistemas de rack diferentes para criar uma configuração de alto desempenho que, segundo a empresa, permitirá a geração de tokens – e receitas – em até 10x a taxa da plataforma Blackwell da última geração. A Nvidia afirma que isso poderia permitir uma oportunidade de inferência anual de até US$ 300 bilhões.

Gráfico detalhando as oportunidades de inferência arquitetônica da Nvidia

Foto cortesia da Nvidia

Um dos maiores fatores facilitadores do Vera Rubin Pod é o uso da plataforma LPX da Groq, aproveitando o chip Groq 3 LM30. A unidade de processamento de linguagem da Groq é inerentemente diferente das GPUs da Nvidia, com uma quantidade significativa de SRAM (memória estática de acesso aleatório) em oposição à DRAM (memória dinâmica de acesso aleatório). Como aumenta a largura de banda da memória em surpreendentes 55x em comparação com uma GPU Rubin, a LPU Groq é inerentemente boa para lidar com tarefas que exigem muita memória. Isso ajuda a explicar por que a Nvidia adquiriu a propriedade intelectual da Groq e seus talentos mais importantes por US$ 20 bilhões em dezembro de 2025.

Crescendo além das GPUs:um foco diversificado em hardware

O exemplo do Groq mostra como a Nvidia está deixando de tentar fazer de suas GPUs a solução para todos os problemas. Embora o ecossistema da Nvidia tenha se expandido há muito tempo para além das GPUs, essa expansão quase sempre esteve a serviço da GPU, seja por meio de CPUs, chips de rede ou software. Com a introdução das LPUs Groq 3, a arquitetura de computação da Nvidia realmente superou a abordagem apenas de GPU.

Também estamos vendo a Nvidia começar a oferecer produtos como suas próprias CPUs internas baseadas em Arm em uma solução de rack somente CPU. A empresa está posicionando a nova CPU Vera de 88 núcleos como competitiva com Intel e AMD para data centers. Essas CPUs podem ser configuradas com até 256 chips por rack, e a Nvidia já tem clientes, incluindo a Meta, que desejam implantá-las. Indo além das CPUs, a Nvidia também falou sobre sua solução Bluefield 4 STX para aplicativos orientados a armazenamento; de acordo com a empresa, este produto melhora o desempenho para evitar que o armazenamento seja um gargalo para a produção de IA.

Mais produtos Vera Rubin:Nvidia DSX AI Factory And Space 1

Nvidia DSX é a mais recente plataforma baseada em Vera Rubin da empresa para sua oferta AI Factory, que inclui um design de referência para fábricas de IA e aproveita o Omniverse Digital Twin da Nvidia. (Para obter informações básicas sobre Omniverse, consulte meu artigo sobre GTC 2025 e a análise detalhada de meu colega Bill Curtis sobre os movimentos da Nvidia em IA física a partir de fevereiro de 2025.) A empresa chama isso de solução pronta para uso que aproveita todos os recursos que a Nvidia e seus parceiros criaram para ajudar a planejar, construir e manter fábricas de IA. Esta plataforma foi projetada para implementações com hiperscaladores e grandes empresas que desejam implantar sua própria IA em escala industrial sem precisar montar uma infraestrutura.

Também tem havido muita agitação ultimamente em torno da computação de IA no espaço, com muitas startups sendo lançadas para resolver os problemas de implantação. Antes do anúncio do módulo Space 1 baseado em Vera Rubin, a Nvidia implantou principalmente chips Jetson Orin integrados e GPUs H100 para aplicações espaciais. A Nvidia diz que o novo módulo focado no espaço foi projetado para essas aplicações extremas e oferece até 25x o desempenho de IA no espaço do H100. Ele também possui processamento lockstep e códigos de correção de erros para garantir que a operação no espaço não afete a produção. Dito isto, acredito que o Espaço 1 abordará uma aplicação bastante específica e não deve ser visto como uma validação da necessidade de data centers no espaço.

NemoClaw:Construindo Agentes Especializados

A Agentic AI rapidamente se tornou uma importante área de foco, à medida que agentes como Claude Code ajudam os usuários a resolver tarefas práticas. Do lado técnico, os agentes estão remodelando a forma como a infraestrutura de TI é construída e como os chips dentro dessa infraestrutura são projetados. Um dos desenvolvimentos recentes mais interessantes é a introdução do OpenClaw, um agente de código aberto que é executado localmente usando a nova pilha NemoClaw de código aberto da Nvidia para implantações mais seguras de agentes orientados a tarefas.

O kit de ferramentas do agente NemoClaw foi projetado para construir, treinar e implantar agentes de IA autônomos e seguros, o que deve facilitar a criação de seus próprios agentes por qualquer pessoa. No desenvolvimento da nova pilha, a Nvidia trabalhou em estreita colaboração com o criador do OpenClaw e com pesquisadores de segurança para ajudar a prevenir ações indesejadas de agentes ou resultados potencialmente perigosos.

DLSS 5.0:a controversa implantação da renderização neural

A Nvidia surpreendeu muitos, inclusive eu, com o anúncio do DLSS 5.0, que é o recurso assistido por IA opcional da empresa para melhorar a qualidade da imagem e fornecer renderização mais rápida. Ele funciona renderizando em uma resolução mais baixa e depois usando IA para aprimorar a imagem para a resolução nativa. A maioria dos usuários parece satisfeita com as implementações anteriores do DLSS. Agora, o DLSS 5.0 introduz técnicas de renderização neural para melhorar ainda mais a iluminação em cenas que, de outra forma, pareceriam planas. Também dá aos desenvolvedores de jogos mais controle sobre a experiência do usuário, e eles podem ajustar o DLSS 5.0 para mudar a forma como ele afeta o visual de seus jogos.

Muitas pessoas reagiram negativamente às primeiras fotos e vídeos feitos com DLSS 5.0. Acho que esta é uma reação exagerada significativa. Existem muitos jogadores que odeiam a maioria das coisas aprimoradas por IA, e a reação ao DLSS 5.0 pode ser o culminar dessa frustração. Tendo visto as demos pessoalmente, posso dizer que quase todas as melhorias parecem positivas e aumentam o realismo – e isso vem de um fotógrafo sério que pode ser muito exigente com as ferramentas de edição. Além disso, o DLSS 5.0 ainda está longe de ser lançado, então não está claro exatamente como será o produto final ou quais GPUs serão capazes de executá-lo. A instanciação atual roda em duas placas gráficas Nvidia RTX 5090, mas, de acordo com a Nvidia, o software será otimizado para rodar em uma única GPU no outono.

O ponto de inflexão da inferência e a projeção de mercado de US$ 1 trilhão de Huang

Em seus comentários no GTC, Huang falou sobre a crescente oportunidade de receita de IA para a indústria, acrescentando que “a demanda por GPUs Nvidia está fora do comum”. Ele afirmou que o crescimento da inferência está gerando receitas significativamente maiores desde a edição especial do GTC realizada em Washington, D.C., no final de 2025 (sobre a qual escrevi aqui).

Embora isso tenha acontecido há apenas alguns meses, a empresa está agora a atualizar a sua oportunidade de receita projetada de 500 mil milhões de dólares até 2026 para 1 bilião de dólares até 2027. Isto significa que a Nvidia não só espera que este ano termine forte, mas também espera que 2027 seja ainda mais forte – centenas de milhares de milhões de dólares mais forte. Do meu ponto de vista como analista, fazia sentido pensar que a transição do treinamento em IA para a inferência generalizada de IA e a IA agente difundida seria um impulsionador significativo para a indústria. Mas se Huang estiver certo, poderá revelar-se um catalisador de crescimento ainda maior – para a Nvidia e os seus parceiros – do que qualquer um teria imaginado há pouco tempo.

Divulgação:Nvidia é um cliente consultivo da minha empresa, Moor Insights &Strategy.

Artigos em Destaque

- Quando a democracia e a centralização se encontram na liderança

- Pessoas e o planeta - Iniciativas de RSE adoçam o sucesso da Ferrero

- Trabalhamos mais quando fomos pagos por hora?

- O que é uma holding?

- Como postar um anúncio no Craigslist

- O que é gestão estratégica?

- O que é o modelo de forças competitivas?

- Como funciona o desemprego

-

O que é um Trader Chefe?

O que é um Trader Chefe? Um negociante principal refere-se ao chefe de uma empresa comercial independente ou ao chefe do departamento de negociação de uma corretora de valores mobiliários registrada ou outra instituição finan...

-

Aqui está o que te faz comprar chocolate chique

Aqui está o que te faz comprar chocolate chique Crédito de imagem:@ jenni.heller / Twenty20 Embora seja verdade que muitos compradores millennials querem gastar de forma ética, pode ficar um pouco opressor muito rápido. Ninguém sabe realmente o qu...